研究者紹介:大道 竜之介

| 所属 | 研究開発統括部 先進技術開発部 新価値G |

|---|---|

| 業務内容 | AIと信号処理による歌声合成技術の研究・開発 |

| 学生時代の専攻 | 電気通信工学 |

| 入社年度 | 2012年度 |

現在の仕事・研究について

私はヤマハに入社して以来ずっと歌声合成技術VOCALOID®に関する研究・開発をしています。

VOCALOID®は2003年にヤマハが発表した歌声合成技術です。私は2012年にヤマハに入社して、まずは製品開発部門で当時のVOCALOID®コア技術を活用する形で、音楽制作初心者向けスマートフォンアプリなどの開発を担当しました。その後、研究開発統括部に移り、現在に至るまで歌声合成のコア技術自体の研究開発を担当しています。

もともとのVOCALOID®は信号処理によるピッチシフトや音色補間の技術を用いて、あらかじめ収録した人間の声のサンプル、すなわちごく短時間の小さな波形をなめらかにつなぎ合わせることで、歌声合成を実現しています。これはとても強力な技術で、個性ある歌手や声優の声をもとにして音楽クリエイターがさまざまなメロディーや表現を与え、新しい音楽を生み出すことを可能にするものです。私は「VOCALOID4」以降の表現力の拡大、たとえば通常のサンプルとは別に収録する表現サンプルのモーフィングによって、グロウルなどの発声技法による歌唱表現を付与する機能の研究開発に携わってきました。

私たちは2018年に、AIを用いた新しい歌声合成技術「VOCALOID:AI®」を開発・発表しました。AIを用いることの利点は、学習もとの歌手が楽譜を解釈し声を発するかのような自然な表現を再現できることです。たとえば歌詞と音域の組み合わせに応じた音色の使い分けや、メロディーの流れに応じたしゃくりやビブラートといったピッチの動きを、学習もとのモデルとなる歌手の歌声データから再現することができます。これにより人間の歌手が元来もつ魅力的かつ幅広い音楽表現をダイレクトに活用した音楽制作が可能になりました。

現在、私の研究の力点はVOCALOID:AI®にありますが、私たちはもともとのVOCALOID®もVOALOID:AI®も、両方の技術を大事に活用していて、実際には信号処理とAIの技術を融合的に活用して最新技術の研究開発を進めています。

AIによる歌声合成は新しい技術で、本当に限界が見えないといっても良いぐらい、幅広い使い方の可能性をもっています。私たちは、単に学習もとの歌手の歌声が自動的に再現される歌声合成技術を目指しているのではありません。主人公は、歌声合成器を使って音楽をつくるクリエイターです。これから世界中の音楽クリエイターが、自らの、自分にしかできない、個性的で魅力あふれる新しい音楽をつくり発信するための欠かせない道具として、私たちの歌声合成器をもっと進化させ届けたいと思っています。

必ずしも人間の歌手の歌声そのものではなく、クリエイターの創造力に呼応して新しい音楽を生み出すために、歌声合成器はどんな音を発することができるか、どのような操作でその音を得るか――そういったことについて、社内のメンバーや社外の音楽クリエイターの方々と議論して検討し、信号処理やAI技術による実現方法を考え、実際に触って音を出せる形にまで実装することが、私たちの仕事です。

私がヤマハを志望した理由

私は大学では通信工学専攻で、通信技術に関係して音声を扱う研究室に所属し、カラオケの採点に関する研究をしていました。歌うことが好きなので合唱部に所属し、またアマチュアオペラでテノール歌手として活動していました。

大学で通信や音声の勉強をしていると、かなり難しい理論や数式を扱います。授業で勉強しはじめたころは、フーリエ変換や畳み込みの積分記号を見るとうんざりしました。こういう難しい勉強をして何の役に立つのか実感がもてず、モチベーションがわかない時期もありました。それでも研究室に所属して歌声を扱うようになってからは楽しく、論文の数式を読み解くことや、それをプログラムとして実装することに面白さを感じました。そして最も楽しいと感じたのは、研究成果を最終的にスマートフォンアプリとして実装し、学会などで自ら歌ってデモンストレーションをしたときでした。

音声の信号処理に関するアカデミックな知識と、それをアプリケーションとして具現化する実装力は、私が学生時代に培った強みです。この強みを活かして仕事をしたいと考えたとき、辿り着いたのがヤマハでした。

音響機器や音楽関係製品を扱うメーカーやソフト開発企業はヤマハ以外にもありますが、そのなかでも私は特にヤマハに惹かれました。それはVOCALOID®の開発元だからという理由だけではありません。うまく説明するのは難しいのですが、人が音を生み出す瞬間・聴く瞬間のワクワクする気持ちにフォーカスを当て、必ずしも数字では測りきれないような楽しさを追い求める気持ちで会社全体が動いているような気がしたからです。私は就職活動をしていたころ、インターンや学会でヤマハの社員に何度も会い、話をするなかでそういう雰囲気を感じました。10年以上勤めたいまも、その印象は変わりません。ときにちょっと気持ちが先行する議論をしたり、実験の結果良い音が出たときに(数字を見るより先に)仲間と一緒に猛烈に喜んだり、そういう空気と目標感のなかだからこそ、冷静に理論を構築したり数式を解く仕事も本当に楽しいと感じます。

最近の研究プロジェクトの例

VOCALOID β Studio:

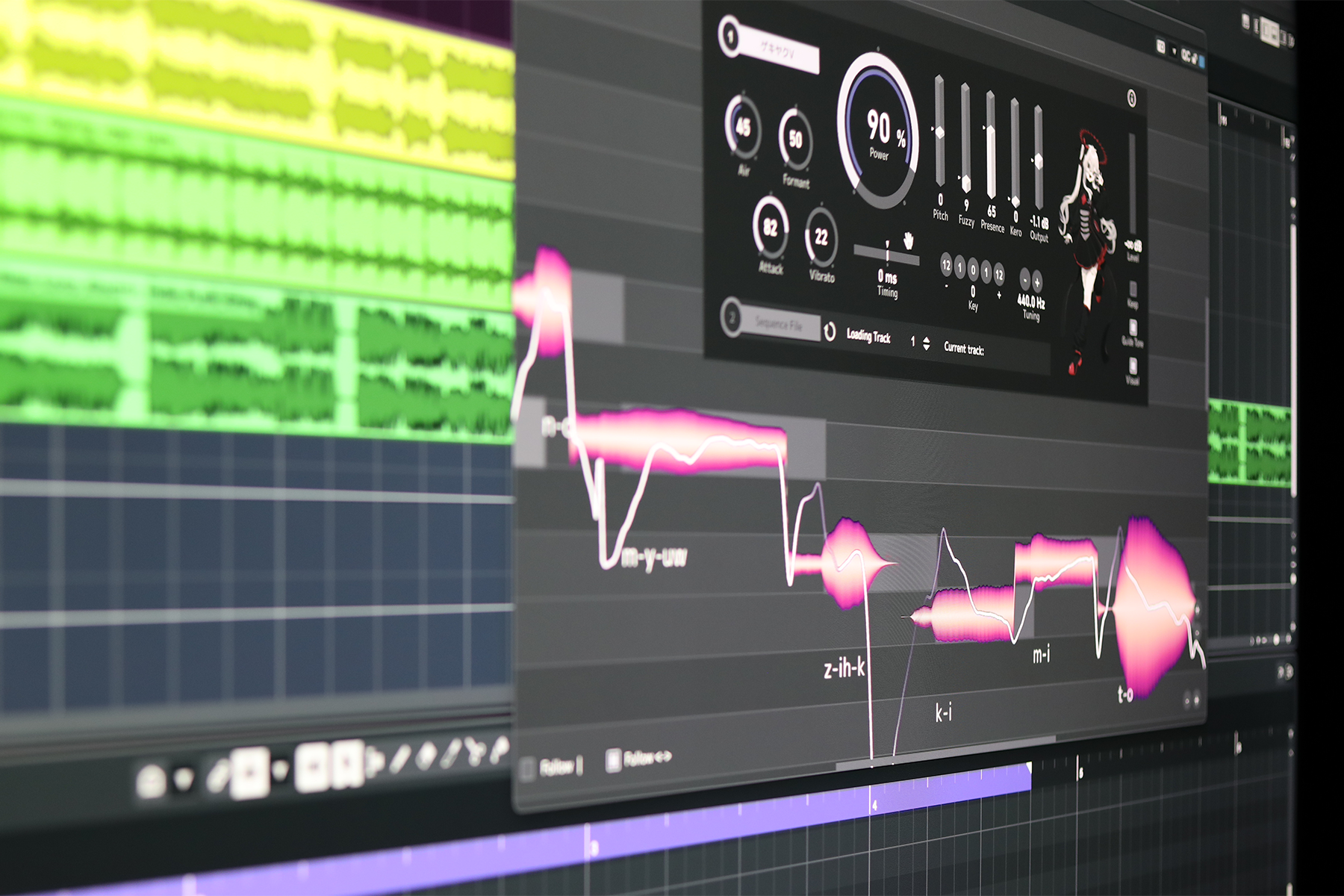

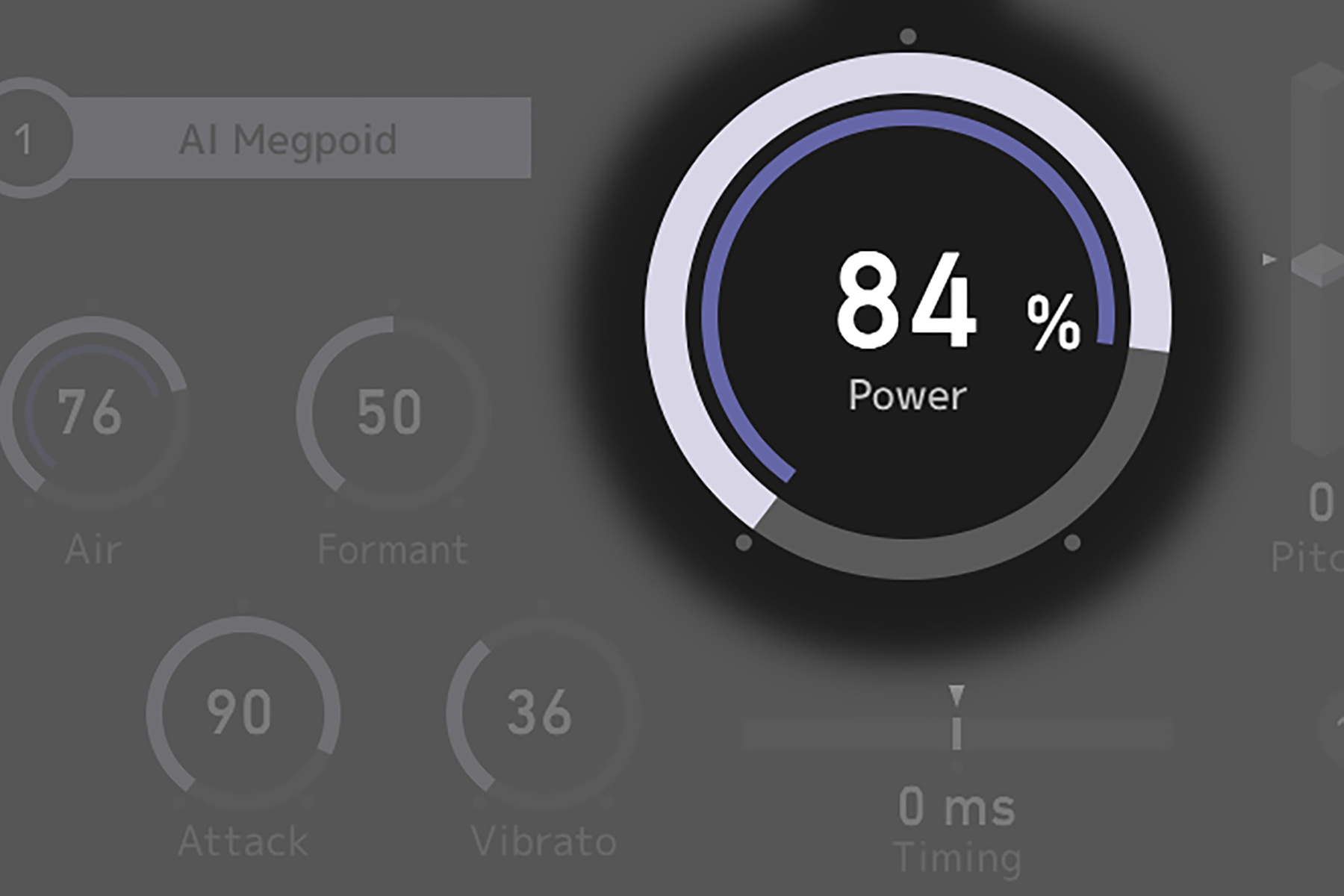

VOCALOID β-Studioは、私たちが2024年に実施した歌声合成の実証実験プロジェクトです。研究段階の新しい歌声合成技術を搭載した、音楽制作ソフト(Digital Audio Workstation:DAW)用プラグイン“VX-β”を期間限定でリリースし、およそ半年の間に数千人ものクリエイターにご試用いただきました。実証実験期間中にさまざまな新しい音楽作品が生まれ、多くのクリエイターから使用感に関するフィードバックを得て、現在私たちは当初の技術のさらなる改良を進めています。

世界中の、いまよりもっと多くの音楽クリエイターが歌声合成を使い、それぞれの個性あふれる音楽を生み出せるようになるにはどうしたら良いか。この問いに対してVOCALOID β-Studioのプロジェクトで私たちが示した答えは、リアルタイムかつ直感的なコントロールができる歌声合成器をつくることでした。従来の歌声合成器は様々な技術的制約のため、楽譜を入力してから歌声が聴けるまでのタイムラグが大きく、また歌声にクリエイターが望む表現力を与えるには、複数のパラメータを詳細に書き込む必要がありました。そこで、私たちがつくったのは、DAW上でリアルタイムに歌声を合成しながらノブをひねるだけで、たとえば「力強さ」といった歌唱表現を瞬時に反映できる新しい歌声合成プラグインです。

歌声合成器として学習元の歌手の再現性だけを追求するのではなく、クリエイターが自身の感性から音楽を生み出す体験についてトータルで考え、そのための道具を具現化したことがこのプロジェクトのポイントだと考えています。歌声合成とユーザーインターフェースを別個に分離して考えるのではなく、クリエイターが実際の音楽制作で音を生み出す瞬間を想定し、ディープニューラルネットワークや信号処理ブロックの構造レベルでの根本的な改良とユーザーインターフェースの研究開発を一体的に行うことで、AIと信号処理の技術を用いた近未来の音楽制作のあり方のひとつを提案することができたと思います。

加えて、このプロジェクトの面白さのひとつは、社内の多くの仲間が集まって実現した点にあります。あるとき私たちがVX-βの原型となるプロトタイプを開発し社内デモンストレーションを実施したことがきっかけで、これまで歌声合成とは直接関係なかった社内の多数の部門から、この技術に興味を持つメンバーが集まり、開発、企画、広報など様々な面で協力することで、最適な形でこの技術をクリエイターに届ける体制が実現できました。さらにこれを発端に、ヤマハのグループ会社でありCubase(キューベース)というDAWの開発元であるSteinbergのメンバーとも技術連携を行い、歌声合成とDAWとの先進的な連携を実現することができました。プロジェクトはいったん完了しましたが、私たちは今もそのとき集まった仲間と協力して次なる改良を進めています。新しい技術を研究・開発しそのポテンシャルを示すことで、共感する仲間が結集し、大きな力となって世界中の音楽クリエイターやプレイヤーに届けるところまでを実現できる点は、ヤマハでの研究開発の醍醐味のひとつだと思います。

なりきりマイク®:

なりきりマイク®は、歌声変換技術を用いた実証実験プロジェクトで、2022年から2024年にかけて実施しました。期間限定で、このシステムが設置されたカラオケボックスで歌うことで、自分の声がリアルタイムに変換され、憧れのアーティストになりきって歌うことができる体験を提供しました。

歌を歌うことは、プロアマ問わず多くの人が楽しめる音楽の形のひとつです。これまで私たちは主に音楽クリエイターのための技術として歌声合成の研究開発を行ってきましたが、その過程で派生技術として開発したのがこの声質変換技術です。この技術も社内でのデモンストレーションがきっかけとなってマーケティング部門の方と本格的な検討が始まり、最終的には誰もが知る有名アーティストとのコラボレーションで、実際の商用カラオケ店舗での実証実験が実現しました。

このプロジェクトでは、技術の応用シーンとしてカラオケボックスという場をみつけ、その場で憧れのアーティストになりきって思いっきり楽しむという明確な状況設定ができたことが極めて重要でした。これには社会的な側面と技術的な側面の考えがあります

まず社会的な側面についてです。歌声(あるいは話し声の声質)変換技術は、多様な声で様々なニュアンスを込めた表現を作り出せる極めて面白い技術ですが、一方で悪用のリスクや権利上の懸念もあり、応用シーンに悩むことが多い技術でもあります。単に歌声変換技術として提案するだけでは、誰がどのようにその技術を使うのかが不明で、音声データの提供者は不安を感じることになります。今回はカラオケボックスという状況設定ができたことで、ファンや一般の方々がその場でアーティストに「なりきって」楽しむという目的が明確となり、アーティストご自身にとっても嬉しい応用の形としてコラボレーションが実現できました。

次に技術的な側面についてです。私たちはこのプロジェクトを通して、歌声変換技術のレイテンシ(歌声を入力してから変換された歌声が聞こえるまでの遅延時間)を改善し、また伴奏音混入に対する頑健性を大幅に向上させることができました。実は、最初に私たちがつくったシステムは、カラオケボックスの現場でテストをしたとき、まったく使い物にならなかったのです。まずレイテンシが大きく非常に歌いづらかったこと、つぎにカラオケの伴奏がマイクに混入して変換の品質が落ちることの2つの問題がありました。通常の研究環境とはあまりにも違う現実の状況に戸惑いましたが、実証実験の開始までに大幅な技術改良を行い、気持ちよく歌える品質を実現しました。

伴奏音混入の課題については、たとえば「伴奏の音量を上げすぎないでください」という張り紙をしておくという代案が出たこともありました。しかしカラオケには、家では出せないような大音量を出すからこそ楽しいという側面があります。技術を活用するために楽しさを犠牲にするのでは本末転倒です。憧れのアーティストになりきって思いっきり楽しむという目的が明確であるからこそ、あくまで通常の大音量の伴奏でカラオケができることにこだわり、ディープニューラルネットワークと信号処理の技術による解決を行いました。

こういった性能は、最終的にはたとえばレイテンシxx [ms]、SNR xx[dB]といった数値指標を用いて定量的に評価し改良を進めることになります。しかしその数値の基準を設定する根拠や、それをクリアすることでどんなに楽しい体験が実現できるかを、私たち自身が実感に基づき理解しているからこそ、短期間に大幅な性能向上を実現し、心から楽しんでいただける体験を多くの方に提供できたと思います。

AI時代における今後の目標

私たちは、世界中の音楽クリエイターが、自らの、自分にしかできない、個性的で魅力溢れる新しい音楽をつくり発信するための道具を生み出したいと思っています。これからAI技術をさらに進化させることによって、クリエイターの創造性をさらに拡大し、あるいは今まで音楽制作のスキルがなかった人もこれに参加することができるようになる大きな可能性を感じています。

AI技術を用いた音楽制作には様々な方向性や評価軸が考えられますが、私は、クリエイターが音・音楽を生み出す瞬間のワクワクする気持ちと、自分ならではの音楽を表現できたという自信を生み出せることを大切にしたいと考えています。なぜならそれらの気持ちが、周囲の人と共有する音楽への情熱や、また次の創作への意欲につながるからです。VOCALOID β-Studioのプロジェクトで試験的に提供したリアルタイムでの表現制御技術は、クリエイターにこの感覚を提供する手段として手応えがあるものでした。こういった実証実験の結果をヒントとして、今後歌声合成に限らず音楽制作の様々な要素において、ユーザー体験と深く連動したAI技術の開発を進めたいと私は考えています。

ワクワク感や自信という側面は、単純に正解率や誤差の指標で測れるものではなく、評価が難しいものです。一方、実証実験を通して実環境で多くのユーザーによる実践的なフィードバックを得る試みは極めて有効で、次なる体験の提案に確実につながっています。今後こういった新時代の研究開発のプロセスを体系化して高速なサイクルで実践し、新しいAI技術を用いた音楽制作の体験を切り開いていくのが、私が目指す研究開発の姿です。